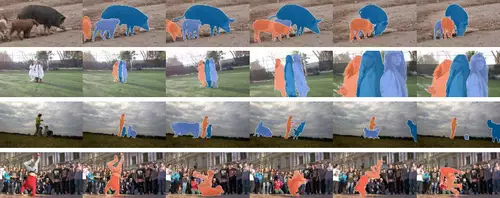

Meta hat die extrem interessante KI zur Erstellung von Objektmasken veröffentlicht und auch gleich zur freien Verfügung ins Netz gestellt. "Segment Anything" (SAM) erkennt Objekte in Bildern und stellt diese automatisch als einzelne Masken frei. Segmentierung bedeutet in diesem Zusammenhang, zu erkennen, welche Pixel in einem Bild zu einem Objekt gehören - eine Aufgabe, die uns als Menschen ganz einfach erscheint, aber für Computerprogramme bisher immer eine große Herausforderung darstellte. Metas neues KI-Modell wurde per Machine Learning anhand Millionen von Bildern samt Objektsegementierungen trainiert und hat dadurch eine allgemeine Vorstellung davon erlernt, was Objekte sind. So kann es jetzt Masken für jedes Objekt in jedem Bild oder Video erzeugen - sogar für Objekte, die nicht im Trainingsmaterial vorhanden waren.

Selbst ausprobieren

Es gibt unterschiedliche Maskierungsmodi: im interaktiven Modus kann per Maus auf Bildobjekte geklickt und diese werden dann maskiert werden - ebenso kann per Rechteck ein Bildbereich definiert werden und alle darin befindlichen Objekte werden automatisch maskiert; im "Alles"-Modus wird jedem Objekt in einem Bild eine Maske zugewiesen. Meta bietet eine Online-Demo, welche im Browser läuft und mittels welcher man SAM in allen drei Modi auch mit eigenen Bildern selbst ausprobieren kann - die Genauigkeit der Objekterkennung war bei unseren Tests beeindruckend. Theoretisch möglich, aber aktuell nicht implementiert ist die Fähigkeit, Objekte per Textprompt auszuwählen.

Die Fähigkeiten von SAM in Sachen Objekterkennung können in zahlreichen Bereichen Anwendung finden: in der kreativen Arbeit für das einfache Maskieren von Objekten in Fotos und Videos zur gezielten Nachbearbeitung oder zum Tracking von bewegten Objekten. In der KI-Forschung könnte SAM als Teil komplexerer Systeme genutzt werden, um ein allgemeineres multimodales Verständnis der Welt zu erlangen, z. B. um sowohl den visuellen als auch den Textinhalt einer Webseite zu verstehen. Andere Einsatzzwecke sind (Verkehrs-)Überwachungssystemen, Objekterkennung in Räumen z.B. für Roboter und andere Anwendungen, wo mit visuellem Input gearbeitet wird.

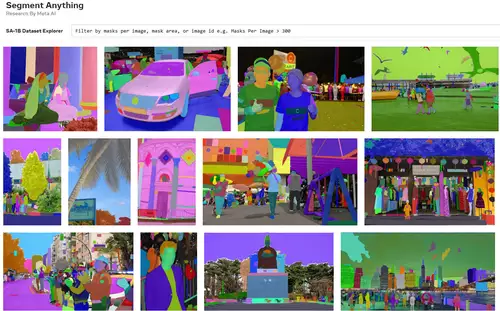

"Segment Anything" besteht aus dem allgemeinen Segment Anything Model (SAM) als auch dem Segment Anything Datensatz (SA-1B), welcher von SAM erzeugt wurde und aus 11 Millionen Bildern und 1.1 Milliarden Masken besteht und der bisher größte diesbezügliche Datensatz aller Zeiten ist. Da Meta den Datensatz für Forschungszwecke zur Verfügung stellt und das Modell samt Quellcode unter einer offenen Lizenz (Apache 2.0) veröffentlicht hat, kann man damit rechnen, daß die hochwertige Bildsegmentierung per SAM bald in vielen weiteren Apps und KI-Projekten genutzt werden wird. Wie schnell das funktioniert, demonstriert das gerade veröffentlichte Chrome-Plugin Magic Copy, das SAM nutzt, um ein Vordergrundobjekt aus einem Bild im Browser zu extrahieren und es in die Zwischenablage zu kopieren.

Wer SAM auf seinem eigenen Computer ausprobieren will, findet hier den Python-Quellcode samt Modell.