Passend zur Weihnachts- und damit Geschichten-Zeit stellt Google Research VideoPoet vor. Hierbei handelt es sich auf den ersten Blick einfach nur um ein weiteres KI-Modell zur Videogenerierung, das jedoch bei näherer Betrachtung dann doch ein paar Besonderheiten aufweist. Grundsätzlich soll besonderer Wert darauf gelegt worden sein, "kohärente große Bewegungen zu erzeugen". Denn vergleichbare Modelle erzeugen bislang noch meistens nur "kleine Bewegungen" oder weisen bei größeren Bewegungen sehr auffällige Artefakte auf.

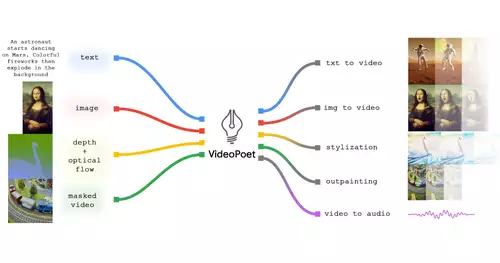

Genauer betrachtet ist VideoPoet, ein großes Sprachmodell (LLM - Large Language Model), das in der Lage ist, eine Vielzahl von Videogenerierungsaufgaben auszuführen, einschließlich Text-zu-Video, Bild-zu-Video, Videostilisierung, Video Inpainting und Outpainting sowie Video-zu-Audio.

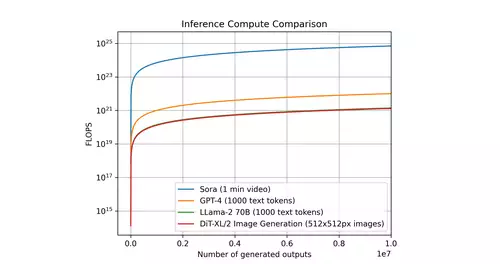

Dies ist insofern bemerkenswert, weil die meisten SOTA-Modelle fast ausschließlich ausschließlich diffusionsbasiert arbeiten. Dagegen hat man bei einem LLM den Vorteil, dass sich hier mehrere Modalitäten (also auch Sprache, Code oder Audio) zur Generierungs-Steuerung nutzen lassen. Und ebendiese sorgen für bislang kaum gesehene Eingriffsmöglichkeiten bei der Generierung. Vielleicht sollte man sich zum Einstieg die folgende Geschichte zu Gemüte führen, die mittel VideoPoet entstanden ist:

Das Drehbuch für diese Kurzgeschichte über einen reisenden Waschbären hat übrigens Googles KI Bart geschrieben - mit einer Aufschlüsselung der einzelnen Szenen und einer Liste von begleitenden Aufforderungen. Anschließend hat VideoPoet daraus dann Videoclips für jeden Take generiert.

Um sich eine vielzahl an so entstanden Videos zu gemüte zu führen, hat Google Research wie üblich eine dedizierte Webseite zum Projekt erstellt, die einen zeitraubenden Überblick über die Fähigkeiten von VideoPoet gibt - was durchaus positiv gemeint ist.